Wahrscheinlichkeit

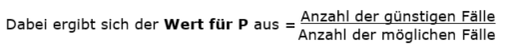

Eine Wahrscheinlichkeit P wird mit einer Zahl zwischen 0 und 1 angegeben:

Axiom 1. 0 ≤ P ≤ 1.

Beispiel (1): Die Wahrscheinlichkeit mit einem Würfelwurf eine "6" zu würfeln, sei p = 1/6. Sie ergibt aus der Anzahl der günstigen Fälle (eine 6 würfeln) durch die Anzahl der überhaupt möglichen Würfel (eine 1, 2, 3, 4, 5, 6 würfeln).

Wenn a notwendig der Fall ist, dann gilt für die Wahrscheinlichkeit P von a:

Axiom 1. P(a) = 1.

Beispiel (2): Die Wahrscheinlichkeit mit einem Würfelwurf eine "1", "2", "3", "4", "5" oder "6" sei notwendig der Fall. Dann ist P(a) = 1.

Und die Wahrscheinlichkeit, dass die atomaren a, b und c der Fall sind, ist:

Axiom 3. P (a v b v c) = P(a) + P(b) + P(c).

Beispiel (3): Die Wahrscheinlichkeit eine gerade Zahl zu Würfeln P (2 v 4 v 6) ist gleich P(1) + P(2) + P(3), also 1/6 + 1/6 + 1/6 = 1/2.

Die Sätze (1) bis (3) bilden grob die drei Axiome der Wahrscheinlichkeits-theorie. Auf diese lassen sich alle weiteren Sätze der WT zurückführen.

1. Interpretationen der Wahrscheinlichkeit

Die Philosophie der Wahrscheinlichkeit gibt sich mit

der reinen Axiomatisierung der Wahrscheinlichkeitstheorie nicht zufrieden. Sie hackt nach:

A. Ontologie: Jetzt haben wir die Wahrscheinlichkeitstheorie formal axiom-atisiert, aber wovon handelt sie inhaltlich: Was ist Wahrscheinlichkeit?

B. Sprache: Jetzt haben wir die W-Theorie syntaktisch charakterisiert, aber was sagt sie semantisch: was bedeuten Wahrscheinlichkeitsaussagen?

Dementsprechend lassen sich die Interpretationen der Wahrscheinlichkeit auch auf zwei Arten verstehen, die dann eine der jeweiligen Formen annehmen:

A. Ontologisches Verständnis: Wenn das Ereignis e mit der Wahrscheinlichkeit P eintritt, dann ist p(E) ontisch ....

B. Sprachliches Verständnis: Die Aussage "die Proposition p ist mit der Wahrscheinlichkeit P wahr", sagt über P(p) semantisch aus ....

Merke: Eine Wahrscheinlichkeit kann sich also grundsätzlich auf ein Ereignis (die Wahrscheinlichkeit, eine "6" zu würfeln) oder auf die Wahrheit einer Proposition (die Wahrscheinlichkeit, mit der "ich würfele eine 6" wahr ist) beziehen.

Grundsätzlich lassen sich Wahrscheinlichkeitsinterpretationen unterteilen in:

Objektive Interpretationen der Wahrscheinlichkeitstheorie: Wahrscheinlichkeitsaussagen beziehen sich auf objektive Sachverhalte.

Subjektive Interpretationen der Wahrscheinlichkeitstheorie: Wahrscheinlichkeitsaussagen beziehen sich auf die epistemische Situation des Sprechers.

1.1. Die klassische Interpretation (objektiv)

Die klassische Interpretation der Wahrscheinlichkeit sagt aus, dass:

A1 ontologisch: Wahrscheinlichkeit das Verhältnis der Anzahl der günstigen Fälle zu der Anzahl aller (gleichwahrscheinlichen) möglichen Fälle ist.

B1 semantische Interpretation: Wahrscheinlichkeitsaussagen das Verhältnis der Anzahl der günstigen Fälle zu der Anzahl aller (gleichwahrscheinlichen) möglichen Fälle ausdrückt.

Diese Interpretation geht im Wesentlichen auf Pierre-Simon Laplace zurück.[L]

Beispiel A1: Die Wahrscheinlichkeit, beim einmaligen Würfeln eine "1" zu würfeln, ist 1/6. Denn das Verhältnis aller günstigen Fälle (eine 6 Würfeln) zu der Gesamtzahl aller möglichen Fälle (eine 1, 2, 3, 4, 5, 6 Würfeln), ist 1/6.

Beispiel B1: Die Wahrscheinlichkeitsaussage, "die Proposition, beim nächsten Wurf wird eine 1 gewürfelt, ist mit der Wahrscheinlichkeit 1/6 wahr" drückt das Verhältnis der günstigen Fälle zu der Gesamtzahl aller möglichen Fällen aus.

Es gilt das Indifferenzprinzip IP[IP]: Alle möglichen Fälle werden als gleich wahrscheinlich angenommen, sofern keine Gründe gegen die Annahme vorliegen.

Beispiel IP: Wir haben vor dem Werfen eines idealen Würfels keinen Grund, mit einer Augenzahl eher zu rechnen als mit einer anderen, deshalb sollten wir annehmen, dass alle möglichen Fälle gleich wahrscheinlich eintreten.

Also: Die klassische Interpretation ist primär eine objektive Interpretation der Wahrscheinlichkeit, denn sie führt Wahrscheinlichkeit auf das objektive Verhältnis zwischen den günstigen und allen möglichen Fällen zurück. Jedoch enthält sie mit dem IP auch ein subjektives Element, das auf epistemische Gründe rekurriert.

Zirkeleinwand: Die klassische Interpretation ist mit vielen Kritikpunkten konfrontiert. Der schwerwiegendste ist dieser hier: Sie definiert "Wahrschein-lichkeit" über das Indifferenzprinzip, d.h. zirkulär über "gleichwahrscheinlich".

Also: Die klassische Interpretation sagt uns nichts über das Wesen von Wahrscheinlichkeit oder Wahrscheinlichkeitsaussagen. Sie ist unbefriedigend.

1.2. Interpretationen der relativen Häufigkeit (objektiv)

Die Häufigkeitsinterpretation besagt, dass Wahrscheinlichkeit letztlich relative Häufigkeit ist bzw. eine Wahrscheinlichkeitaussage auf eine solche referiert.

Dabei gilt: Ein Ereignis E tritt mit der Wahrscheinlichkeit p ein, gdw. es zu einer Klasse von Ereignissen gehört, die mit der relativen Häufigkeit p* eintreten.

Beispiel A2: Die Wahrscheinlichkeit, beim nächsten Wurf eine 1 zu würfeln, ist 1/6. Denn das Ereignis "beim nächsten Wurf eine 1 würfeln" gehört zu einer Klasse von Ereignissen, die mit der relativen Häufigkeit 1/6 eintreten.

Beispiel B2: Die Wahrscheinlichkeitsaussage, "die Proposition, beim nächsten Wurf wird eine 1 gewürfelt, ist mit der Wahrscheinlichkeit 1/6 wahr" drückt aus, dass die relative Häufigkeit von Einserwürfen bei einer unendlichen Folge von Würfen gegen 1/6 konvergiert.

Referenzklasseneinwand: Die Häufigkeitsinterpretation kann Ereignissen ohne Referenzklasse keine Wahrscheinlichkeiten zuweisen. Wollen wir beispielsweise die Wahrscheinlichkeit dafür angeben, dass eine bestimmte Person an einer bestimmten Krebsart erkrankt, müssen wir die relative Häufigkeit dieser Krebsart in der Referenzklasse dieser Person betrachten. Doch für eine bestimmte Person kommen verschiedene Referenzklassen in Frage, beispielsweise Personen ähnlichen Alters oder Körpergewichts, desselben Geschlechts oder Berufs. Die relative Häufigkeit der Krebsart kann jedoch von Klasse zu Klasse variieren.

Einzelfalleinwand: Die Häufigkeitsinterpretation kann einmaligen Ereignissen keine Wahrscheinlichkeit zuweisen. Wollen wir beispielsweise die Wahrscheinlichkeit dafür ausmachen, dass Bernie Sanders die US-Wahl 2020 gewinnt,

Bezugseinwand: Die Häufigkeitsinterpretation kann Einzelereignisse oder Propositionen, die keine Ereignisse beschreiben, keine Wahrscheinlichkeit zuordnen. Zum Beispiel das Einzelereignis "Bernie Sanders gewinnt 2020 die US-Wahl" oder Wahrheit der Proposition "Wenn Kurt raucht, bekommt er Lungenkrebs". Denn dafür

Long-Run-Frequency-Einwand: Es gibt keine Garantie, dass die relative Häufigkeit, die wir bisher beobachtet haben, der Konvergenz-Häufigkeit auf lange Sicht auch nur ähnelt. Also können wir nie zu gerechtfertigten Wahrscheinlichkeitsaussagen gelangen.

Einzelnachweise

[L] Pierre-Simon Laplace: A Philosophical Essay on Probabilities (1814).

[IP] (auch: Prinzip vom unzureichenden Grund, Prinzip der maximalen Entropie)

Stand: 2019

Philoclopedia

Philoclopedia

Philoclopedia (Dienstag, 17 September 2019 18:16)

In den meisten (nicht allen) Fällen, in denen wir einen bestimmten Wettquotienten für den richtigen halten, haben wir nicht primär entsprechend graduierte Überzeugungen (degrees of belief, die als psychologische Größen eine extreme Idealisierung darstellen), sondern einfache Überzeugungen über Grade (beliefs about degrees) – nämlich über Grade objektiver oder ontischer Wahrscheinlichkeit. Wir wollen mit quantifizierten Wahrscheinlichkeitsaussagen typischerweise nicht lediglich einen Überzeugungsgrad ausdrücken, sondern eine Aussage über die Wirklichkeit machen. Wir meinen etwa, dass die objektive Wahrscheinlichkeit, bei einem Wurf mit zwei Würfeln die Augensumme 7 zu erzielen, 1/6 beträgt. Deshalb, und nur deshalb, halten wir einen Einsatz von zwei Talern gegen zehn Taler darauf, dass dieses Ereignis eintritt, für fair. Uns ist bewusst, dass wir dabei irren können: Vielleicht ist die Wahrscheinlichkeit für das Resultat gar nicht 1/6, weil mit den Würfeln oder der Wurfprozedur etwas nicht in Ordnung ist.

Für diesen Kontrast hat sich die Rede von subjektiven und objektiven Wahrscheinlichkeiten eingebürgert. Es handelt sich um den Gegensatz zwischen dem, was unsere Informationen (auf der Subjektseite) wie stark nahelegen, und dem, was in Wirklichkeit (auf der Objektseite) der Fall ist. Klarer wäre es, von epistemischen und ontischen Wahrscheinlichkeiten zu sprechen, um Verwechslungen beim objektiven Bayes ianismus und der logischen Wahrscheinlichkeit zu vermeiden: Diese sind epistemische und insofern subjektive Deutungen der Wahrscheinlichkeit. Eine ontische Deutung braucht man insbesondere für die Wahrscheinlichkeitsaussagen der empirischen Wissenschaften, die als Behauptungen über die Wirklichkeit auftreten.